بواسطة

Justin Wong

—

هل ستحل الذكاء الاصطناعي محل كتاب المحتوى؟ تطور ومستقبل كتابة المحتوى بالذكاء الاصطناعي

مع تقدم توليد النصوص وتعلّم الآلة، يدور الكثير من الحديث حول ما إذا كان كُتّاب المحتوى سيُستبدلون بالعدد الهائل من أدوات كتابة النصوص بالذكاء الاصطناعي التي توفر وظيفة الإكمال التلقائي.

GPT-3، Rytr, Jarvis, Shortly, CopyAI, Frase، وغيرها - والقائمة التي تظهر فيها منتجات جديدة مزودة بالإكمال التلقائي في السوق لا تنتهي. جميع هذه المنتجات تتضمن زرًا بعنوان "اكتب لي". تنقر على ذلك الزر، فيخرج لك منه فقرة كاملة من النص.

يكاد الأمر يبدو كالسحر.

بوصفي باحثًا في الذكاء الاصطناعي، تابعتُ التطورات في هذا المجال خلال السنوات الخمس الماضية - ومن المدهش كيف تحوّل شيء بدأ كوسيلة لإكمال رسائل النص إلى تقنية قادرة الآن على إنتاج روايات كاملة تقريبًا.

لكن هل يعني ذلك أن الذكاء الاصطناعي يمكنه أن يحل محل كتّاب النصوص الإعلانية - وهل أصبحت الكتابة البشرية شيئًا من الماضي؟ الإجابة معقدة.

للإجابة عن هذا السؤال، علينا أولًا أن نكشف الستار لنرى كيف يعمل الإكمال التلقائي لكتابة المحتوى فعليًا. ومسلحين بهذه المعرفة، يمكننا التعمق في المفاضلات التي تجلبها هذه التقنية القائمة على الذكاء الاصطناعي، ومعرفة ما إذا كان على الكتّاب القلق وسط كل هذه الأدوات الكتابية بالذكاء الاصطناعي الموجودة في السوق.

كيف تطور الإكمال التلقائي لكتابة المحتوى

مع كل الضجة المحيطة بالاختراقات الجديدة في الذكاء الاصطناعي مثل GPT-3، من السهل أن ننسى كيف تطورت تقنية النص التنبؤي (الإكمال التلقائي والتصحيح التلقائي) عبر العقود.

نعم، هذه هي الميزة الموجودة في هاتف iPhone 5 القديم التي تصحح لك كلمة "iz" إلى "is"، وهي أيضًا الطريقة التي يقترح بها Google لك أحيانًا بشكل طريف إكمالات لبحثك.

الاعتماد على N-Grams ليكتب بالنيابة عنك

قد تتفاجأ، لكن تقنية الإكمال التلقائي يمكن إرجاعها إلى عام 1948. ومنذ ذلك الحين، ساعدت كتّاب المحتوى في التدقيق الإملائي وتصحيح كتاباتهم.

دعنا نلقِ نظرة على البدايات المتواضعة للإكمال التلقائي.

اعتمدت العديد من أنظمة الإكمال التلقائي المبكرة على مفهوم نموذج اللغة. وكان هذا في الأساس نموذجًا يمكنه التنبؤ بالكلمة التالية بناءً على تاريخ الكلمات السابقة.

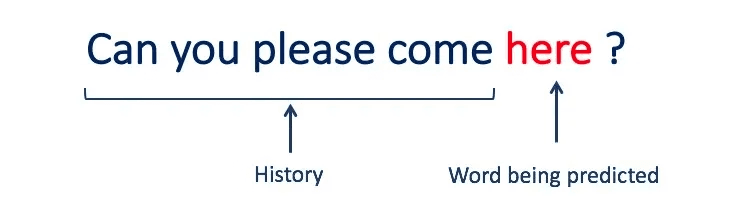

أقدم نموذج لغوي، والذي أشار إليه كلود شانون أولًا، كان يُسمّى نموذج n-grams. وكان أحد استخدامات n-grams هو التنبؤ بمدى احتمال ظهور مجموعة من الكلمات في النص الذي تكتبه.

فعلى سبيل المثال، إذا كتبتَ "Can you please come" (أي كلمات التاريخ)، فسيتوقع نموذج n-grams أن تكون الكلمة التالية "here" محتملة جدًا (مثلًا بنسبة 80%). ثم سيعرض هاتفك عليك إكمال العبارة بكلمة "here".

كيف يعرف n-grams الكلمات المرجح ظهورها؟

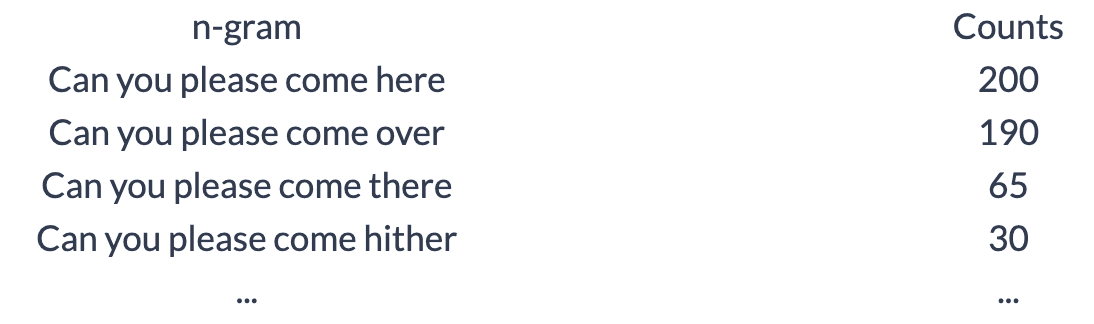

يمكنك إنشاء نموذج n-grams ببساطة عبر عدّ عدد المرات التي ظهرت فيها العبارة "Can you please come here" في مجموعة من النصوص عالية الجودة (وتُسمى أيضًا بيانات التدريب). إذا ظهرت هذه العبارة كثيرًا، فهذا يعني أن "here" غالبًا ما تكون إكمالًا صحيحًا - وإلا فهي صياغة غير مرجحة.

ويُطبَّق هذا العدّ على جميع العبارات الممكنة في المجموعة النصية، وينتج عن ذلك "جدول للأعداد".

في المثال أعلاه، يحصل الصف الأول على أعلى عدد لأنه يظهر في اللغة المكتوبة البشرية أكثر من غيره. أما الصف الأخير فمكتوب بإنجليزية متخصصة وغريبة ولا يظهر كثيرًا في اللغة الحديثة، لذلك يكون عدده أقل.

ومع هذا الجدول، كلما كتب أحدهم، فإن البرنامج سينظر إلى هذا الجدول ليجد العبارة المطابقة ذات العدد الأعلى. وهذه المطابقة الأفضل هي في الأساس تنبؤ بالكلمة التالية المفترض ظهورها. كما تتيح هذه المطابقة للبرنامج أن يمنحك تقديرًا للاحتمال (مثلًا: فرصة 80% لإكمال صحيح اعتمادًا على المجموعة النصية).

وها قد وصلنا - السحر وراء كثير من أدوات الإكمال التلقائي يتلخص في عدّ الكلمات!

وبصورة مبسطة جدًا، هكذا تُبنى نموذجًا يمكنه التنبؤ بالكلمة التالية الأكثر احتمالًا اعتمادًا على مجموعة معينة من كلمات التاريخ. وهذا هو الأساس الذي تعمل به أنظمة التصحيح التلقائي والإكمال التلقائي.

فهل سيتم استبدال كتّاب النصوص الإعلانية بنموذج n-grams؟

قطعًا لا.

هناك مشكلة أساسية في n-grams - فهو يمثل اللغة بطريقة متفرقة. وببساطة، يعني هذا أنه إذا كانت لديك كمية كبيرة من البيانات، فسيصبح جدولك ضخمًا جدًا. وهنا يأتي دور الشبكات العصبية مثل GPT.

الانتقال إلى ما هو أبعد من جدول مع GPT

ما نستخدمه اليوم قطع شوطًا طويلًا منذ نموذج n-grams.

يعتمد الذكاء الاصطناعي الحديث للإكمال التلقائي على الشبكات العصبية، وهي أقوى بكثير من نماذج n-grams. ورغم أنها أكثر تطورًا، فإن الشبكات العصبية تعتمد على المبدأ الأساسي نفسه: العدّ الإحصائي.

أما GPT-3 (المحوّل التوليدي المدرب مسبقًا الإصدار 3) فهو نموذج لغوي ضخم قائم على شبكة عصبية طورته OpenAI، وأصبح الآن العمود الفقري لكل أدوات الكتابة بالإكمال التلقائي التي أُطلقت مؤخرًا في السوق. ويأتي GPT-3 ضمن توجه في معالجة اللغة الطبيعية (NLP) نحو الشبكات العصبية الكبيرة المدربة مسبقًا.

مع GPT-3، لم نعد نستخدم ببساطة جدولًا لتخزين جميع العبارات الممكنة، بل نخزن ملخصًا مضغوطًا لها داخل أوزان الشبكة العصبية. وهذا يتيح لنا تدريب نماذج على مليارات العبارات والجمل التي كان من المستحيل إدراجها في جدول واحد.

فكيف يكتب لك GPT-3؟

تمامًا مثل n-grams، عندما تكتب كلمة أو عبارة، يحاول GPT-3 العثور على الكلمة الأكثر احتمالًا لإكمال جملتك اعتمادًا على مجموعة النصوص التي درّب عليها.

لكن الأمر لا يتوقف عند هذا الحد. فبمجرد أن يتوقع الكلمة التالية التي ستكتبها، يستمر في ذلك داخل حلقة ويواصل التنبؤ بالكلمة التالية حتى يكتب فقرة كاملة. وهكذا يقوم "بتوليد" فقرة لك.

لكن لحظة - إذا كان كل ما يفعله GPT-3 هو البحث عن احتمالات مستمدة من محتوى كُتب مسبقًا، فهل يعني هذا أنه يكرر ببساطة ما قرأه، أم أنه مبدع فعلًا؟

هذا سؤال فلسفي صعب يبرز كثيرًا في النقاشات الحالية حول المحتوى المُولَّد بالذكاء الاصطناعي.

مفاهيم خاطئة حول كتابة المحتوى بالذكاء الاصطناعي

هل يمكن لكتابة المحتوى بالذكاء الاصطناعي أن تكون إبداعية؟

لاحظ كثير من المنتقدين أن GPT-3، مثل جميع نماذج الذكاء الاصطناعي، لا يستطيع إلا توليد نص رآه من قبل. ويقولون إن الكتابة بالذكاء الاصطناعي تفتقر إلى الإبداع وإن هذه الأدوات لا تصلح إلا لنشر محتوى مكرر.

ورغم أن هذا الرأي كان صحيحًا في السابق، فإنه لم يعد دقيقًا بالكامل اليوم.

من السهل القول إن نموذج n-grams من عام 1948 كان سيعيد ببساطة المحتوى الموجود لأنه يخزن حرفيًا كل بيانات التدريب الخاصة به في جدول ويقوم بـ"توليد" النص عبر التصفح بين العبارات التي رآها.

لكن لأن GPT-3 مضغِّط شديد الكفاءة للنصوص التي تدرب عليها، فإنه يضطر إلى تطوير قواعد وأنماط للمحتوى المكتوب - فهو لا يتذكر دائمًا الجملة نفسها حرفيًا من بيانات التدريب المخزنة في ذاكرته.

ورغم أن بضع جمل قد تُولَّد حرفيًا، فإن كثيرًا من العبارات الناتجة تكون جديدة. وإجراء بحث سريع في Google عن النص المُولَّد سيُظهر لك أن معظم المخرجات أصلية.

سواء أكنت تؤمن بأن GPT-3 (أو أي نموذج ذكاء اصطناعي وأدوات ذكاء اصطناعي) قادر على إنتاج كتابة أصلية أم لا، فهذا موضع نقاش، ويعتمد على كيفية تعريفك لـالأصالة. ففي النهاية، تعلّم البشر من أعمال عظيمة سابقة وابتكروا أعمالًا مشتقة من شكسبير، فهل البشر حقًا أصليون إلى هذا الحد؟

ورغم أن الذكاء الاصطناعي الحديث ينتج نصوصًا قد تشبه ما هو موجود أصلًا، فإنه يمكنه أيضًا أن ينتج نصوصًا قد تفاجئك.

وعلى كتّاب المحتوى والمحررين البشريين أن يستفيدوا من هذا العنصر المفاجئ بأفضل شكل.

إن الاستخدام الأفضل للإكمال التلقائي ينبغي أن يشمل قيام الكتّاب بفرز النصوص التي يولدها الذكاء الاصطناعي واختيار الأفضل منها، أو استخدامه مصدرًا للإلهام لكسر الجمود الكتابي.

هل يمكن لكتابة المحتوى بالذكاء الاصطناعي أن تحمل مشاعر؟

أحد المخاوف المتعلقة بكتابة المحتوى بالذكاء الاصطناعي هو أنه سيُنتج نصًا بلا روح وبلا مشاعر.

هذا أيضًا تعميم واسع يفتقر إلى الدقة - وربما ينبع من تصورنا المستمد من الخيال العلمي عن الذكاء الاصطناعي بوصفه روبوتات معدنية بلا مشاعر.

ومرة أخرى، من غير المرجح أن تنتج النماذج البسيطة مثل n-gram نصًا عاطفيًا لأنها تفتقر إلى القدرة التمثيلية - إذ لديها حد عملي لكمية ما يمكنها تعلمه.

لكن لأن GPT-3 يتعلم من مجموعة ضخمة من النصوص ذات سياق أوسع، فإنه غالبًا ما يستطيع تقليد المشاعر والنبرة في الكتابة. وهذا يعني أنه إذا كتبتَ عبارة مثل "أشعر بالحزن اليوم"، فسيحاول النموذج اختيار الكلمات الأنسب لتعكس هذا الشعور في النص المولد.

(الفقرة التي قرأتها للتو أعلاه أُكملت بالكامل بواسطة Jenni AI دون أي تعديلات. لقد تعلمتُ مطابقة نبرتي وأسلوب كتابتي من الفقرات السابقة.)

وتُظهر دراسة نُشرت في ICLR 2020 أن مولدات النصوص العصبية يمكنها حتى أن تكرر كثيرًا وتبدأ في أن تصبح متكررة. ومع ذلك، فإن الترديد ليس هو نفسه امتلاك المشاعر.

بصفتك كاتبًا، ستظل بحاجة إلى أن تكون أنت المسؤول عن النبرة العامة والعاطفة في كتابتك. فبينما يستطيع الذكاء الاصطناعي إنتاج نص يعكس المشاعر البشرية، فإنه لا يملك خبرة فعلية بتجربة أن تكون إنسانًا - إنه ليس ذكاءً متجسدًا.

تذكّر، مثل نماذج n-grams، فإن GPT-3 مدرب على مجموعة نصوص (معظمها من الإنترنت ومن إنتاج كاتب بشري).

إنه لم يرَ أو يختبر أي شيء آخر يختبره الإنسان العادي - ولن يعرف أبدًا طعم البرغر بالجبن، كما لا يستطيع أن يتعاطف بالكامل. ووفقًا لـOpenAI، لا يمكنه الإجابة بدقة عن أسئلة تتعلق بالعالم المادي، مثل: "إذا وضعتُ الجبن في الثلاجة، هل سيذوب؟".

وهذا قيدٌ متأصل في نماذج اللغة الحديثة التي ستظهر خلال السنوات القليلة المقبلة - على الأقل إلى أن يمنح الذكاء الاصطناعي جسدًا ماديًا.

وفي كتابة المحتوى، فإن فهم هذا القيد أمر بالغ الأهمية.

وهذا يعني أنه لكي نستفيد حقًا من قوة الذكاء الاصطناعي في كتابة المحتوى، علينا أن نقدم له التوجيه والملاحظات لنقوده في الاتجاه الصحيح.

لماذا يُعد الذكاء الاصطناعي + الإنسان مستقبل كتابة المحتوى

قد تدفع هذه السلبيات كثيرين إلى التشكيك في التقدم الحاصل في كتابة المحتوى بالذكاء الاصطناعي أو الخوف من أن مستقبلنا سيغصّ بـمحتوى مكرر ومزعج.

وعلى العكس تمامًا، أتوقع مستقبلًا أكثر إشراقًا بكثير.

في عام 1996، عندما كان نظام الذكاء الاصطناعي من IBM في لعبة الشطرنج، اعتُقد أن لعبة الشطرنج قد حُسمت ولن يبقى أي لاعب شطرنج.

لكن ما حدث هو عودة قوية للأشخاص الذين تعلموا استراتيجيات شطرنج جديدة من خلال دراسة حركات الذكاء الاصطناعي. وحدثت ظاهرة مشابهة بعد أن هزم AlphaGo من DeepMind اللاعب لي سيدول، أفضل لاعب في العالم في لعبة الغو عام 2016.

النجاح في الذكاء الاصطناعي يعني أن البشر عليهم التكيف والتغيير - وقد يكون هذا التغيير غير مريح، لكنه غالبًا ما يكون للأفضل. فبينما يستطيع الذكاء الاصطناعي التفوق على البشر في بعض المهام، فإن البشر أفضل في المهارات العامة، ويمكننا تعلم دمج الذكاء الاصطناعي لتعزيز إنتاجيتنا الشاملة.

وينطبق هذا أيضًا على كتابة المحتوى، حيث يحتاج الكتّاب إلى دمج استراتيجية محتوى عالية المستوى، ورؤية الشركة وعلامتها التجارية، وفهم الجمهور داخل محتواهم.

ولهذا أتوقع مستقبلًا يجمع أفضل ما في العالمين - البشر والذكاء الاصطناعي يعملون معًا لإنتاج محتوى أعلى جودة بكثير.

هل ستصبح الكتابة الإعلانية من الماضي غدًا؟

مع التطور المتسارع للتقنية، يصعب ألا نتساءل - هل وظيفة كاتب المحتوى مهددة مستقبلًا؟

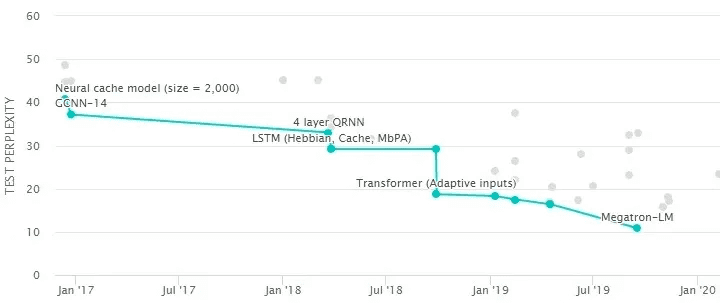

إذا نظرنا إلى اتجاه تحسن نماذج اللغة عبر السنوات، يتضح أن الذكاء الاصطناعي يزداد قدرة على الإكمال التلقائي للنصوص. وقد انخفضت قيمة الارتباك (وهي مقياس للخطأ) للذكاء الاصطناعي على معيار شائع مثل WikiText-103 من 40 إلى 10 خلال السنوات الثلاث الماضية - وهذا تحسن بمقدار 4 أضعاف!

وبالاستناد إلى هذا النمو الأُسّي، نتوقع خلال السنوات الخمس المقبلة تحسنًا إضافيًا بمقدار 10 أضعاف في جودة تقنية الإكمال التلقائي.

هذا يعني أنه إذا كان كل ما تفعله في كتابة محتوى SEO هو إنتاج أعمال منخفضة القيمة - مثل إعادة صياغة المحتوى الموجود، أو تعبئة القوالب، أو النسخ واللصق لقوائم المقالات، أو تدوير محتوى الآخرين - فـالإجابة نعم، أنت في خطر.

إذًا، ماذا يعني هذا بالنسبة إلى كتّاب النصوص الجادين والمتحمسين لما يفعلونه؟

لا تقل "اكتب لي"، بل "اكتب معي"

هناك سبب لعدم استخدامنا الآلات الكاتبة اليوم. وهو أن كتابة المحتوى لا تتعلق بوضع الحبر على ورقة.

وهناك سبب لعدم تدقيق القواعد يدويًا بعد الآن. وهو أن القواعد تفصيل تقني وليست جوهر محتواك الحقيقي.

إن تلبية نية بحث المستخدمين والظهور بوصفك خبيرًا في المجال في تخصصك المحدد سيجعل قراءك يعودون للمزيد. وسيتشاركون مقالاتك طبيعيًا على نطاق أوسع، ما يساعد مقالك على الارتفاع في ترتيب نتائج محركات البحث.

ورغم كل هذه التطورات في طريقة كتابتنا باستخدام التكنولوجيا، يظل الكاتب هو صاحب الرؤية الخاصة بالمحتوى. التعزيز بدلًا من الاستبدال هو المفتاح.

إذا كان الذكاء الاصطناعي هنا لإزالة الأعمال ذات المستوى المنخفض، فعليك بصفتك كاتب نصوص أن تغيّر أساليبك لتؤدي أعمالًا أعلى قيمة. حان الوقت للتفكير بعمق أكبر في نوع المحتوى الذي تنتجه.

هناك 7.5 مليون مدونة تُنشر كل يوم ومحتواك يجب أن يبرز.

مهمتك هي ربط النقاط بين استراتيجية التسويق والجمهور والمحتوى - عبر تقديم معلومات وأبحاث وأفكار فريدة - ثم عرضها كقصة لم يروها الآخرون من قبل. قصة تجذب الانتباه وتحافظ على تفاعل القراء حتى نهاية النص.

وهذا يعني أن الكتابة ستصبح أقل ارتباطًا بميكانيكية وضع الكلمات على الورق، وأكثر ارتباطًا بالأفكار التي تريد إيصالها وفن سرد القصص.

علينا أن نتوقف عن الاعتماد على الذكاء الاصطناعي ليكتب لنا، وأن نكتب مع الذكاء الاصطناعي.

إذا كانت وظيفتك تتضمن التعاطف مع القارئ لإنشاء محتوى عالي الجودة وجذاب يلقى صدى لدى جمهورك ويقدم قيمة حقيقية - فدورك في أمان.

كيف يمكن لـ Jenni أن تساعد

في Jenni، نعمل بجد لجعل هذا التكامل بين البشر والذكاء الاصطناعي سلسًا قدر الإمكان - ولهذا صممنا بعناية نظام الإكمال التلقائي المعتمد على GPT-3 بحيث لا يعيقك، بل يبقيك أنت - صانع المحتوى - في مقعد القيادة. دائمًا!

اعتبارًا من مارس 2022، قررنا التوقف التدريجي عن ميزة "اكتب لي" - كما تعلمون، ذلك الزر الذي تضغط عليه فيكتب لك فقرة كاملة بسحرٍ غريب! مدهش!

ويرجع ذلك إلى أننا وجدنا من خلال العديد من دراسات حالات المستخدمين - أن أكثر من نصف المستخدمين الجدد الذين مُنحوا إمكانية الوصول إلى أزرار "اكتب لي" كانوا ينقرون عليها لإنتاج حوالي 80% من محتواهم - وكان معظم هذا المحتوى منخفض الجودة.

إن إغراء هذا الزر يجعل إنشاء المحتوى المزعج أمرًا سهلًا جدًا، كما أنه يبعدك عن أن تكون أنت مؤلف قصتك.

وبدلًا من ذلك، ستساعدك Jenni الآن عبر تقديم اقتراحات لك بشكل نشط أثناء الكتابة، مع التكامل بسلاسة في عملية إنشاء المحتوى الخاصة بك.

وهذا سيساعدك كثيرًا على التغلب على أي جمود كتابي، كما سيعيد المتعة والشغف إلى حرفتك.